臺灣大學電機資訊學院師生於科技部舉辦的《科技大擂台:與AI 對話》競賽中奪冠

語音技術為AI的核心,今日的AI可以理解人類語言到甚麼地步呢?為了鼓勵了中文語音AI技術的開發,科技部舉辦了AI競賽《科技大擂台:與 AI 對話》,可說是有史以來第一場AI的中文聽力理解能力測驗,這個比賽從 2018 年 3 月開始,一直到 2019 年3 月結束,比賽期間長達一年,一開始共計143組隊伍報名,700 餘人參賽,經歷六次初賽、複賽會前賽、複賽的層層塞選,最後總共9組隊伍進入決賽,最終由本校電機資訊學院師生所組成的團隊奪冠(成員依姓名筆劃如下:李宏毅教授、吳宗翰、陳延昊、陳縕儂教授、黃兆緯、葉奕廷、劉記良、劉浩然、錢柏均、謝濬丞)。

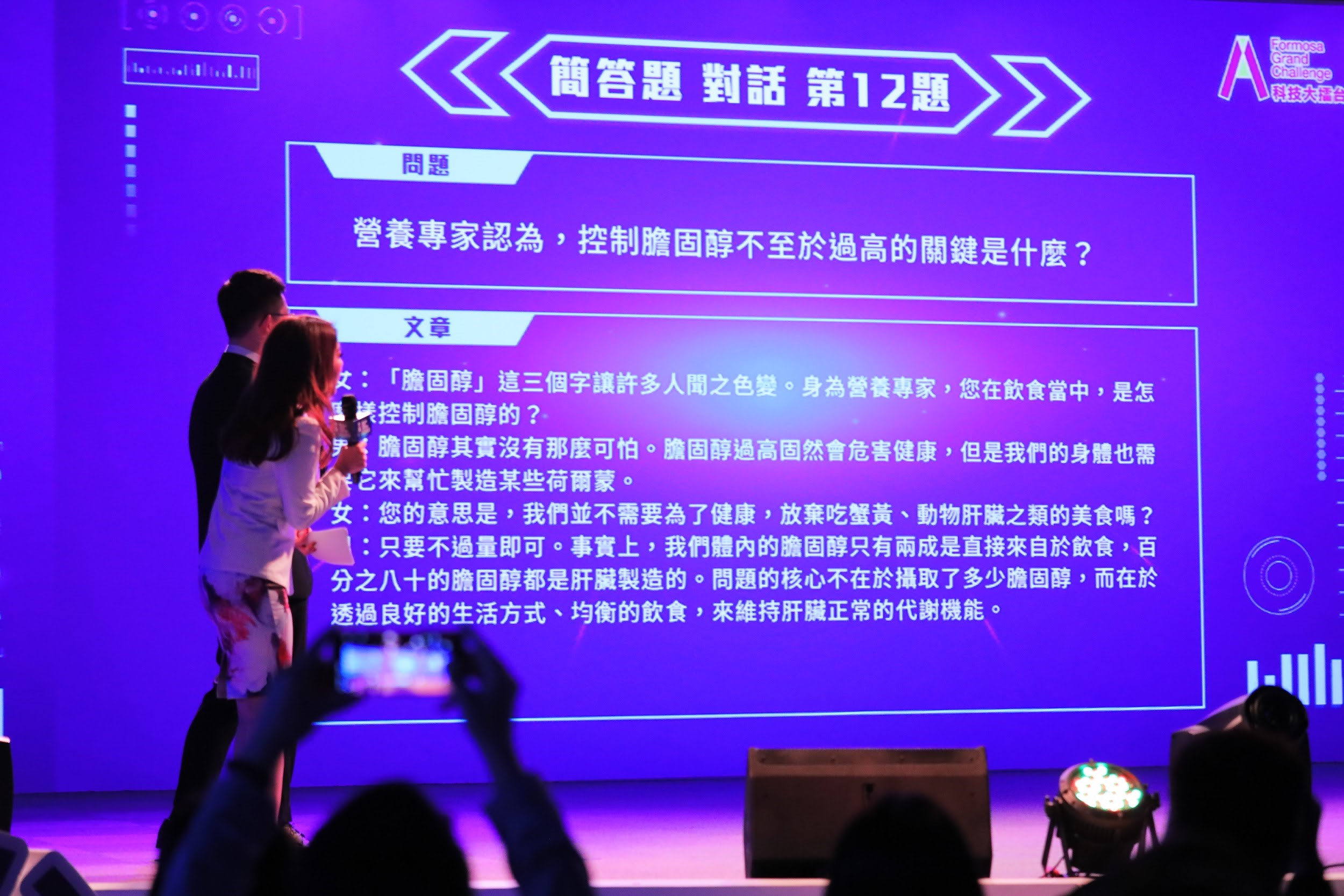

科技大擂台在比什麼 讀者可以想像《科技大擂台:與 AI 對話》這場比賽就是機器的中文聽力理解能力測驗,首先機器會聽到一段語音,可能是兩人間的對話、廣播新聞、甚至是小說朗讀,內容幾乎沒有限制,甚麼樣內容都可能被拿來出題,接下來由人類詢問問題,機器給出答案。回答有兩種形式,在「選擇題」中,機器會有四個選項,只需要選出正確的選項即可;在「簡答題」中,機器必須自己以文字輸出答案,挑戰非常大,不過只有決賽有出現簡答題。

比賽又分為線上賽和現場賽。初賽和複賽會前賽是線上賽,在線上賽中參賽隊伍可以在比賽前一晚取得音檔,也就是說參賽團隊有一個晚上的時間可以根據音檔內容客製化使用的AI技術,隔天上午比賽開始時會取得問題和選項,取得問題和選項後,機器有一個小時可以作答,需要在一個小時內上傳機器作答的結果,每次比賽問題都至少有上千題,人類絕不可能在時限內完成,但機器可以辦到,每次比賽總共有五次上傳的機會,可以即時知道在所有參賽隊伍中的排名,過程非常刺激(在比賽過程中主辦單位有跟拍部分團隊製作成紀錄片)。

複賽和決賽是「現場賽」,參賽團隊將程式佈署在主辦單位的機器上,主辦單位將敘述、問題、選項的音檔一題一題地傳給參賽團隊的程式,參賽團隊的程式需要在時限內傳回答案,就跟在考聽力理解測驗是一樣的,在複賽時主辦單位甚至邀請三位人類考生和機器同台較量。現場賽對參賽團隊來說是極大的挑戰,一般在進行機器學習比賽時,因為有不只一次機會,所以一次上傳結果不好,通常可以調了參數、換了模型再試,但是現場賽佈署完後就不能再更動程式,因此只有一次機會而已,跟一般機器學習的比賽相比挑戰更大,不過也更接近真實的應用情境。 要讓機器去考聽力測驗,參賽團隊至少需要具備以下兩項技術:(1) 語音辨識:機器必須要能將聽到的語音轉成文字。(2) 語意理解:機器必須要理解語音辨識系統辨識出來的文字內容,才能根據問題找出文章中的答案。以下分別概述臺大團隊在上述兩項技術上所做的成果。 語音辨識 在這次比賽中,為了讓參賽團隊有大量語料可以訓練語音辨識系統,主辦單位和公共電視台、國立教育廣播電臺、均一教育平台、政大之聲等機構合作提供了將近 2,000 小時的節目內容做為訓練語音辨識系統的語料資料庫。雖然市面上已經有不少商用語音辨識系統,但根據賽制和題目的設計,有自建語音辨識系統技術的團隊會佔有優勢,因此在比賽中,台大的團隊還是使用自己開發的語音辨識系統。 在初賽中,有幾次音檔的內容較難辨識,例如當音檔的內容是章回小說的朗讀時,因為章回小說的用詞和句法跟現代的白話文有所不同,一般商用的語音辨識系統辨識章回小說的內容其正確率會是非常低的,需要有自建語音辨識系統的能力針對章回小說客製化語音辨識系統,才有可能得到較為準確的辨識結果,因此沒有自建語音辨識技術的團隊很容易在初賽時就被淘汰。雖然在現實的應用上大概是沒有甚麼機會需要辨識章回小說,不過同樣的客製化語音辨識系統的技術也可以拿來用在辨識其他帶有大量專業詞彙的音檔上,例如:法庭攻防的錄音、醫病的對話、專業課程錄音等。 語意理解 光是可以把語音辨識為文字,只完成了挑戰的一半,接下來機器必須要知道文字背後的語意,才能根據問題產生答案。臺大團隊完全採用深度學習技術來讓機器理解文字並進而得到答案,我們訓練了一個類神經網路,只要輸入音檔的語音辨識結果、問題、選項,這個類神經網路就會輸出它認為答案是四個選項中的哪一個。類神經網路的學習需要大量的練習題,練習題中需要包含音檔、問題、選項以及正確答案,學習的過程完全是自動的,並不需要使用人力撰寫程式教機器要如何答題,也不需要人工輸入人類語言的文法規則,而是讓機器根據人類提供的練習題自己找出答題的方式。在上述的學習方法中,練習題的數量決定了類神經網路答題的正確率,所以臺大團隊花費大量資源尋找可用的練習題,例如:蒐集國中小閱讀測驗的試題、購買人類在考的中文聽力測驗考古題等。 最終本校電資學院的團隊於決賽的 1000 題選擇題中得到 53.7%的正確率,奪得本次比賽的冠軍,展現了電資學院多年來在AI領域卓越的研發和教學成果。